Nelle scorse settimane ha suscitato orrore e indignazione il caso del bidello catanese arrestato per pedopornografia virtuale. L’uomo sfruttando l’intelligenza artificiale sarebbe riuscito a convertire le foto scattate alle piccole allieve della scuola media in cui prestava servizio in immagini di nudo, comparendo anche lui nelle scabrose fotografie. Per comprendere meglio il fenomeno dei “deepfake” e dei rischi dell’intelligenza artificiale ci siamo recati così presso la facoltà di Matematica e Informatica dell’Università degli Studi di Catania dove abbiamo intervistato il professore Sebastiano Battiato, ordinario di Informatica, che ci ha spiegato come con l’IA stia diventando sempre più difficile distinguere il falso dalla realtà.

Il prof. Battiato al QdS: “Nuovi software IA rendono complicato distinguere il falso dal vero”

“I recenti fatti di cronaca – esordisce il docente ai microfoni di QdS.it – costituiscono uno degli utilizzi non consoni delle nuove tecnologie. Viviamo in un momento storico in cui anche con i nostri smartphone abbiamo la possibilità di alterare in maniera semplice e diretta il contenuto delle foto o dei video che produciamo. Ciò consente praticamente a chiunque di creare dei falsi. Le prime generazioni di software che permettevano ciò erano più approssimative, arrivando a generare delle vistose alterazioni, degli artefatti visivi che permettevano di individuare a occhio nudo delle lacune fisiche nella generazione dei contenuti. Purtroppo, man mano che la tecnologia va avanti, queste alterazioni sono però diventate più rare“.

“Le armi dell’Università contro l’errato utilizzo dell’intelligenza artificiale: cosa sono le E-AI”

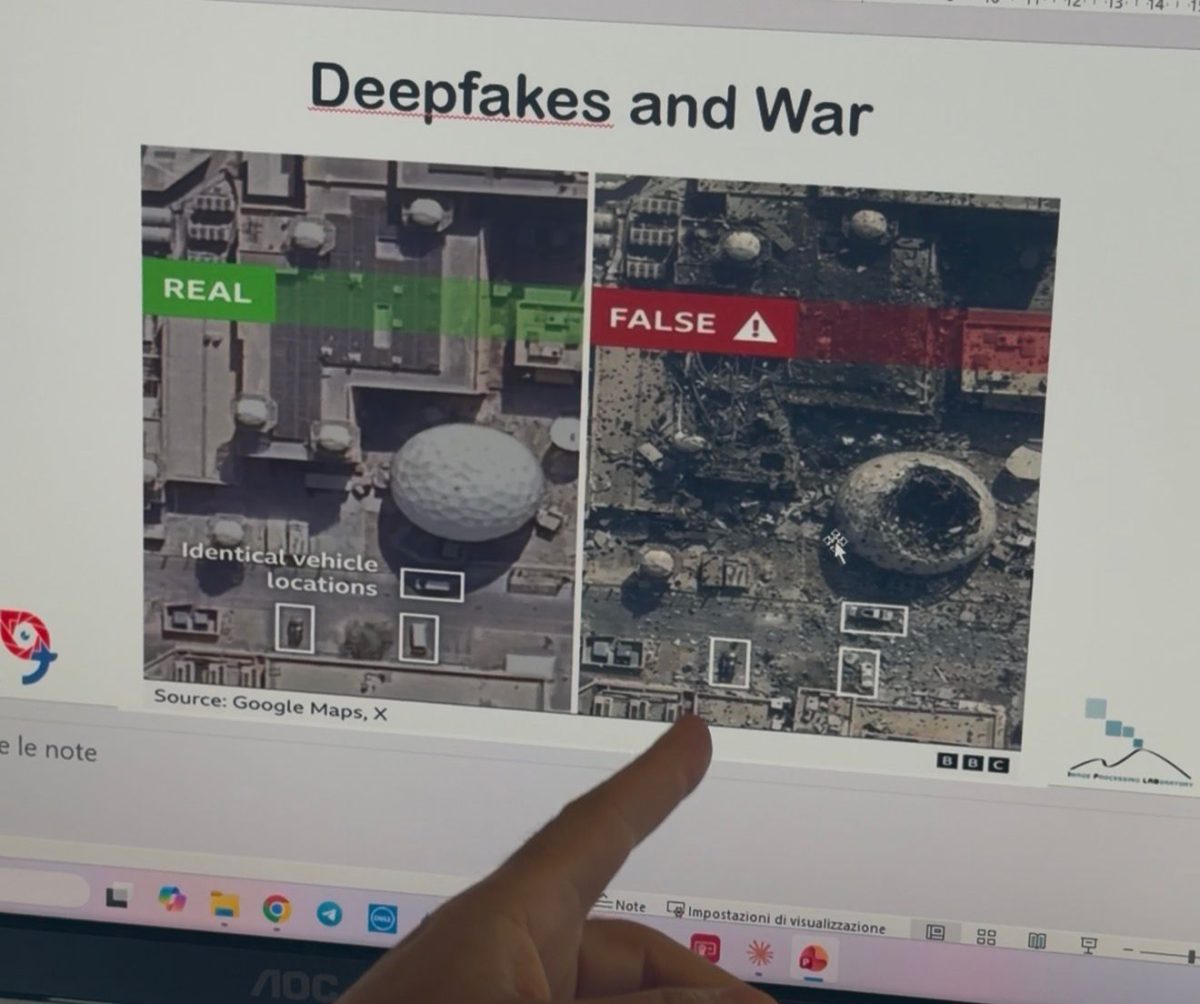

Per riuscire a non farsi ingannare da ciò che si trova in rete, dunque, servono nuove armi tecnologiche ed informatiche in modo tale da riuscire a comprendere cosa sia reale da ciò che non lo è: “Sì, servono nuove armi a supporto di questo tipo di problema. A tal proposito, quello che noi facciamo come Università, è quello di sviluppare delle E-AI che permettono di analizzare i contenuti fake e trovare al loro interno, attraverso degli algoritmi, le differenze rispetto ad un contenuto reale. Tutte quelle differenze che, seppur prodotte da macchine, il nostro occhio a primo impatto non è in grado di cogliere. Collezioniamo dunque i cosiddetti “dataset”, cioè gli esempi prodotti dall’IA, li confrontiamo tra loro e proviamo a distinguere ciò che è reale da quello che non lo è. Nel nostro laboratorio creiamo degli algoritmi che permettono di effettuare tali operazioni: ci serviamo, in proposito, di particolari “mappe” che ci consentono, ad esempio, di individuare se in una scena esistono punti di fuga differenti. Quello che noi facciamo è produrre dei “tool” che possano, a partire da un’immagine, riconoscere quelle caratteristiche “false” da quelle invece vere”.

“Ecco come distinguere i fake da ciò che è reale: attenzione alle truffe”

Cosa possono fare, dunque, le persone che ogni giorno visionano sui propri smartphone o pc per non cadere nella trappola dei “deepfake” e dei falsi generati dall’intelligenza artificiale? Il professor Battiato conclude così: “Innanzitutto, credo che sia fondamentale cominciare ad essere più cauti. Dobbiamo iniziare a dubitare dei contenuti che ci vengono propinati su social, media e giornali. Occorre avere occhio critico. Bisogna affiancare all’immagine il contesto, per verificare se ciò che stiamo vedendo in un dato momento può essere o meno plausibile. Sottolineo, inoltre, di stare attenti alle truffe attraverso le finte telefonate con il “voice-cloning”: in molti, soprattutto gli anziani, ricevono chiamate da finti figli, parenti o affetti cari da parte di malviventi che hanno come obiettivo quello di un cospicuo ritorno economico. Bisogna bypassare l’effetto cognitivo iniziale: contestualizzare e agire con fredda razionalità possono costituire un ottimo deterrente. In questo senso, l’impatto dell’Università è fondamentale perché uno dei nostri obblighi è quello di riuscire a realizzare attività di formazione e di consapevolezza nelle persone, negli studenti e nella società su come queste nuove tecnologie possano e debbano essere utilizzate soltanto a fin di bene”.

Segui tutti gli aggiornamenti di QdS.it sui canali WhatsApp e Telegram