RAGUSA – Oggi, una delle preoccupazioni maggiori in tema di intelligenza artificiale riguarda la sfera etica. è recente la notizia della collaborazione tra i colossi tecnologici IBM e Microsoft, i quali hanno presentato a Roma, al Governo e allo stato pontificio, il documento “Rome Call for AI Ethics” a favore di una visione etica dell’Intelligenza Artificiale. Ciò dimostra come l’aspetto etico della cosiddetta “AI” sia molto discusso a livello nazionale e internazionale.

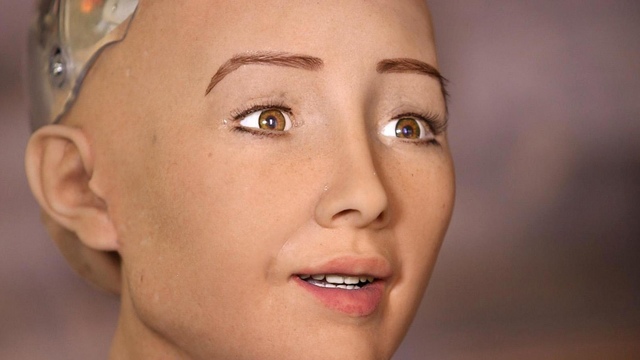

Sembra inesorabile che le macchine arriveranno a sviluppare capacità pratiche, mnemoniche e cognitive comparabili a quelle umane e, senza troppe difficoltà, a superarle. Il problema sorgerà quando le macchine inizieranno a eguagliare le emozioni caratteristiche dell’essere umano.

è possibile allora individuare un limite netto ed universale tra “semplice algoritmo” ed “essere empatico”?

Per Intelligenza Artificiale si intende quella disciplina che studia in che modo si possono riprodurre i processi mentali più complessi mediante l’uso di un computer.

La comunità scientifica internazionale sta attualmente lavorando alla cosiddetta “superintelligenza”, una intelligenza artificiale il cui obiettivo è quello di replicare completamente l’intelligenza umana. Essa fa riferimento alla branca della ricerca dell’“intelligenza artificiale forte”, secondo la quale è possibile per le macchine diventare sapienti, coscienti di sé, arrivando quindi a sviluppare una propria intelligenza in modo autonomo; il che va oltre i limiti etici e morali.

Fare in modo che l’AI possa essere progettata, sviluppata e controllata da una grande rete internazionale, attraverso la programmazione open source, è per molti ricercatori e scienziati l’approccio più sicuro per controllare la superintelligenza risolvendo problemi etici e di sicurezza.

Una delle preoccupazioni maggiori in questo ambito, riguarda proprio l’utilizzo dei dati e la fiducia con la quale le AI sfruttano dati ed informazioni per giungere a determinate decisioni e/o compiere azioni specifiche. La mente umana, non è in grado di interpretare l’insieme di azioni compiute da un’AI, né di prevedere le sue future intenzioni.

In questo scenario, la blockchain sembra essere il sistema di controllo più rassicurante: l’uso della tecnologia blockchain consente registrazioni immutabili di tutti i dati, di tutte le variabili e di tutti i processi utilizzati dalle intelligenze artificiali per arrivare alle loro conclusioni/decisioni. Nonostante ciò, rimane comunque presente un’alta percentuale di rischio. Chi ci assicura che la macchina non sia in grado di sviluppare col tempo una sorta di immunità contro questi sistemi di controllo?

Bisognerebbe probabilmente limitarsi alla cosiddetta “intelligenza artificiale debole”, la quale identifica sistemi tecnologici in grado di simulare alcune funzionalità cognitive dell’uomo, senza però eguagliare le sue reali capacità intellettuali.

Tutti conoscono le auto senza guidatore o gli assistenti vocali, come Siri di Apple, Cortana di Microsoft o Alexa di Amazon, ma gli esempi meno noti sono molteplici. Gli algoritmi intelligenti, in grado cioè di auto-apprendere, ci suggeriscono i prodotti da acquistare, i film o i brani musicali in linea con i nostri gusti, sanno rispondere a domande dei clienti via chat, possono riconoscere il volto di una persona per abilitare un accesso, supportare i medici nelle diagnosi, filtrare i curriculum.

L’AI risulta essere utile all’uomo in svariati ambiti: parafrasando una celebre frase di Blade Runner può essere paragonata ad una sorta di “Eldorado di nuove occasioni e avventure”; tuttavia in una società che produce “macchine che si comportano come uomini e uomini che si comportano come macchine“ (Fromm), non è possibile individuare un confine netto da porre alla scienza; colonne d’Ercole invalicabili, capaci di preservare la superiorità dell’uomo, legata alla sua sfera emotiva e all’apprendimento socio-relazionale.

Enrico Antolino

Claudio Arancio Febbo

Luca Francone

Arianna Fumarola

Nunzio Licalzi

4A s.a. Liceo Enrico Fermi, Ragusa